DeepSeek выпустила флагманские LLM V4 — V4-Pro и V4-Flash. Это большое обновление ИИ-модели V3, которую выпустили ещё в начале 2025 года. Обе модели работают с контекстом в 1 млн токенов, а также получили открытый код и открытые веса.

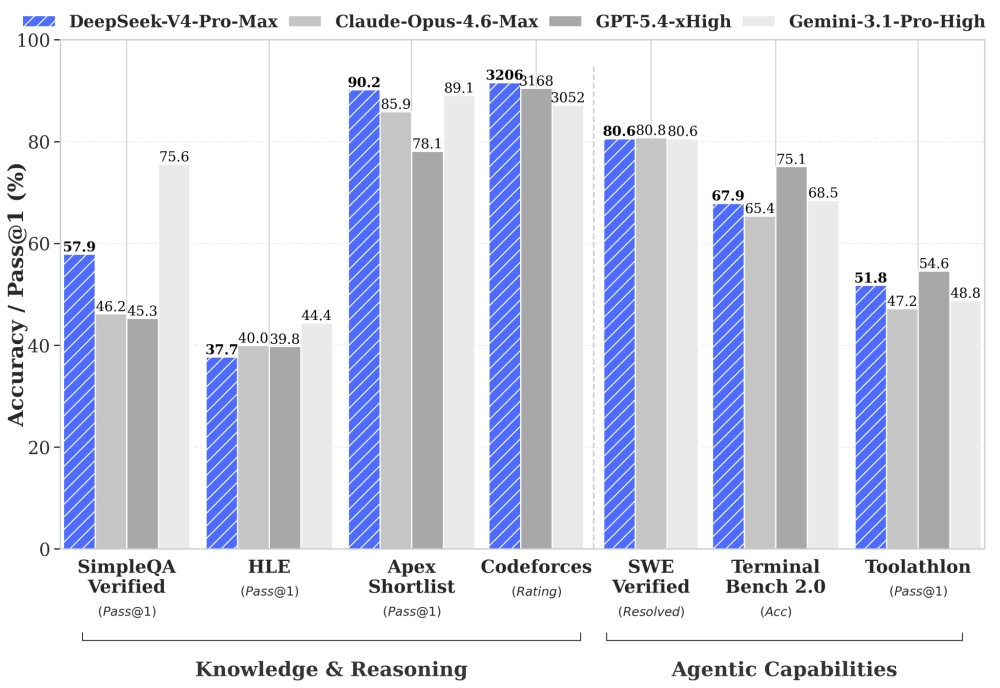

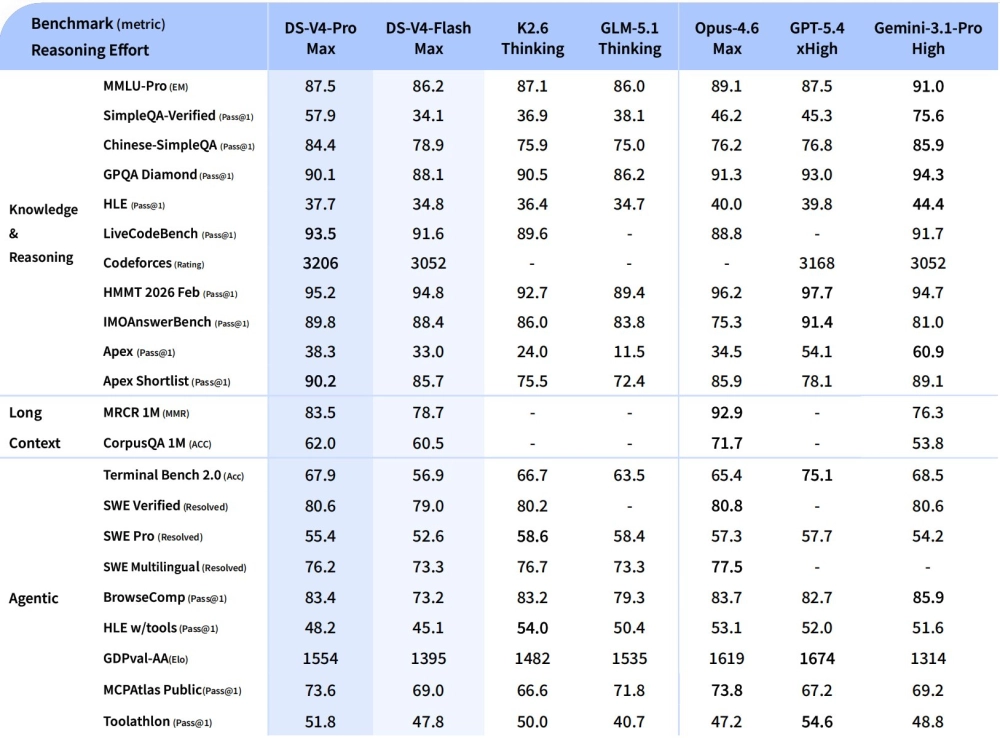

- DeepSeek-V4-Pro: 1,6T параметров (49B активных). Производительность, «сопоставимая с лучшими в мире закрытыми моделями».

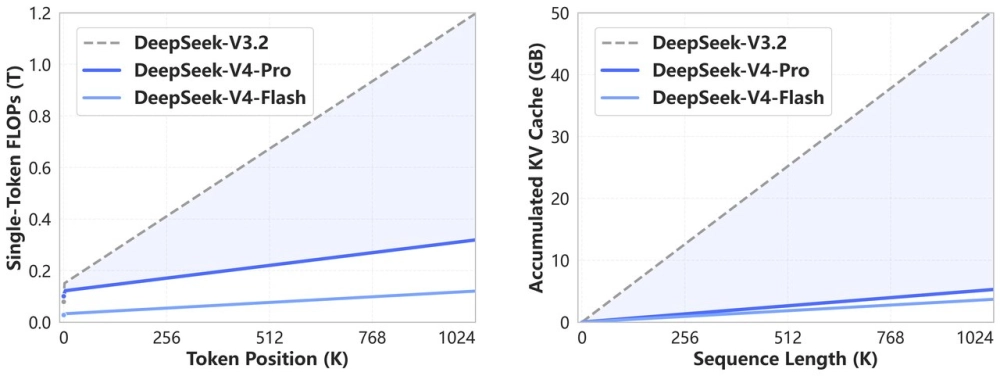

- DeepSeek-V4-Flash: всего 284B параметров (13B активных).

Особенности V4-Pro:

- расширенные агентные возможности: open-source SOTA в coding-агентах;

- знания о мире «уступают только Gemini-3.1-Pro»;

- превосходит все текущие открытые модели в Math/STEM/Coding, соперничая с лучшими закрытыми моделями.

Особенности V4-Flash:

- возможности рассуждения почти на уровне V4-Pro;

- простые задачи агента на уровне V4-Pro;

- меньший размер параметров, более высокая скорость отклика и выгодная цена API.

Кроме того, в DeepSeek отмечают, что V4 легко интегрируются в Claude Code, OpenClaw и OpenCode.

Как попробовать DeepSeek V4?

Новые модели уже доступны в веб-версии и приложении DeepSeek, где Instant это V4-Flash, а Expert — V4-Pro. По API-интерфейсу для разработчиков V4 тоже доступны.

Цены API:

- V4-Pro — 1,74 долларов (~132 рубля) и 3,48 долларов (~264 рубля) за 1 млн токенов на вход и выход соответственно

- V4-Flash — 0,14 долларов (~11 рублей) и 0,28 долларов (~22 рубля) за 1 млн токенов на вход и выход соответственно

С открытыми весами V4 можно ознакомиться здесь, а с техническим отчётом — здесь.

Источник:

DeepSeek