Сэм Альтман объявил в 𝕏, что OpenAI достигла соглашения об использовании своих моделей в работе Минобороны США. До этого Пентагон полагался на Claude от Anthropic, однако в начале этого года между ИИ-компанией и министерством возник конфликт.

Хронология событий

Сотрудничество Anthropic и Минобороны США

Летом 2024 года компания заключила партнёрство с Palantir, которая занимается разведкой совместно с ЦРУ и другими органами США. Это привело к тому, что Claude интегрировали в засекреченные сети Пентагона, что стало прецедентом для коммерческих ИИ-компаний.

Через год Anthropic заключила контракт на 200 млн долларов непосредственно с Министерством обороны США (которое в администрации Трампа называют Министерством войны). Компания обязалась предоставить министерству доступ к «передовым AI-возможностям» в интересах госбезопасности США.

В этом же контракте были прописаны условия Anthropic, среди которых — запрет на использование Claude для массовой слежки за гражданами и управление полностью автономными системами вооружений.

Эскалация конфликта в январе–феврале 2026 года

В начале января службы США провели в Каракасе операцию, в ходе которой захватили Николаса Мадуро, бывшего президента Венесуэлы. В The Wall Street Journal сообщили, что для планирования и проведения операции использовались ИИ-решения от Anthropic.

По информации источников СМИ, после этого в Anthropic подняли вопрос, не нарушают ли действия США условия контракта.

Официально в Anthropic отвергли сообщения СМИ:

«Мы не можем комментировать, использовался ли Claude или любая другая модель ИИ для каких-либо конкретных операций, секретных или иных. Любое использование Claude, будь то в частном секторе или в государственных структурах, должно соответствовать нашим правилам. Мы тесно сотрудничаем с нашими партнёрами для обеспечения соблюдения этих правил»— Anthropic

Однако 24 февраля, по данным Axios, Минобороны поставило Anthropic ультиматум: или компания соглашается на «использование ИИ-модели для любых законных целей» в срок до 17:01 27 февраля, или к ней применяются следующие санкции:

- расторжение контракта с Минобороны на 200 млн долларов;

- присвоение статуса supply chain risk, который фактически запрещает подрядчикам использовать продукты Anthropic в работе с государством;

- принудительное сотрудничество через «Закон об оборонном производстве» 1950 года — он даёт президенту США полномочия обязывать частные компании выполнять госзаказы, если те поручаются в интересах национальной безопасности.

«Единственная причина, по которой мы вообще продолжаем с разговаривать с [Anthropic] — они нам нужны, и нужны прямо сейчас. Проблема для них в том, что они настолько хороши»— анонимный представитель Пентагона

26 февраля Дарио Амодей развёрнуто прокомментировал ситуацию. Глава компании рассказал, что Anthropic готова и дальше предоставлять ведомству доступ к Claude, однако она не станет этого делать, если службы будут использовать ИИ для слежки за гражданами США, а также для работы с автономным оружием — чтобы ИИ мог самостоятельно убивать людей.

Таким образом, Anthropic отказалась предоставить военным полный доступ к ИИ-моделям. В Пентагоне такой ответ восприняли как попытку диктовать условия.

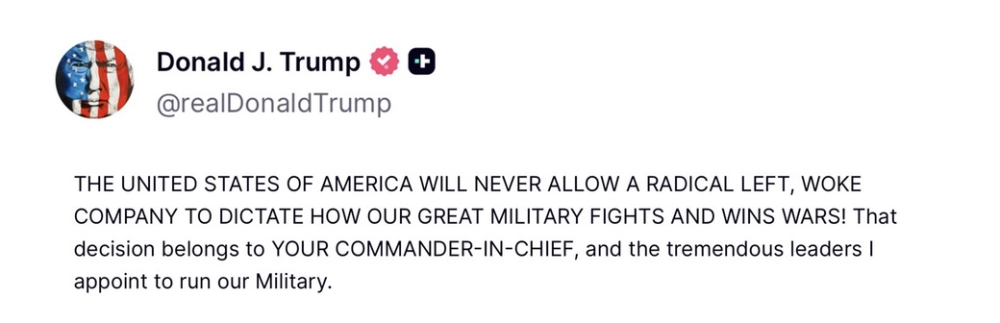

В резкой форме против компании высказался и Дональд Трамп:

«Я приказываю каждому федеральному ведомству в правительстве Соединённых Штатов немедленно прекратить любое использование технологий Anthropic. Они нам не нужны, мы их не хотим и больше не будем вести с ними дела!»— Трамп

Сотрудничество Минобороны США и OpenAI

28 февраля Сэм Альтман объявил о сделке OpenAI и Минобороны США. По словам Альтмана, ведомство согласилось с принципами компании — не использовать ИИ для массовой слежки и управления автономным оружием.

«Два наших важнейших принципа безопасности — это запрет на массовую слежку внутри страны и ответственность человека за применение силы, в том числе в отношении автономных систем вооружения. Министерство войны разделяет эти принципы, отражает их в законодательстве и политике»— пишет Альтман

Такие же условия привели к конфликту министерства и Anthropic.

Однако в случае с OpenAI речь идёт только об обещаниях Пентагона, которые тот даёт. Anthropic в свою очередь отказывалась сотрудничать до тех пор, пока не будет гарантий, что их ИИ технически не получится использовать для слежки и управления оружием.