Google объявила о выпуске модели Gemini 2.5 Computer Use, которая научилась взаимодействовать с пользовательскими интерфейсами — от сайтов до операционных систем по принципу ИИ-агентов.

Работает это так: по запросу пользователя модель анализирует происходящее на экране, и выдаёт конечный результат, будь то щелчок по ссылке или ввод текста. Например, модель можно попросить упорядочить заметки в браузере.

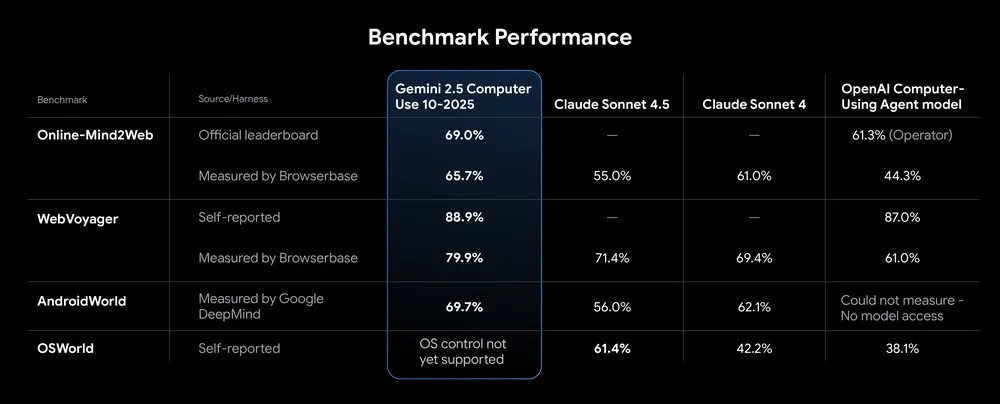

В событиях, требующих повышенной безопасности, например, подтверждение покупки, пользователю нужно будет подтвердить запрос вручную. После каждого запроса окружение анализируется вновь. Google заявляет, что модель превосходит ведущие альтернативы в различных тестах и предлагает уменьшенную задержку:

Наилучшие результаты, по уточнению компании, достигаются внутри веб-браузеров, а для управления настольными ОС модель пока не подходит.

Разработчики могут получить доступ к новым возможностям через Gemini API в Google AI Studio и Vertex AI.